红了芭蕉,绿了杨柳。在这样一个春光旖旎的日子里,坐落在陆家嘴的君悦大酒店双鱼厅迎来了Gartner总监分析师Nick先生,他就人工智能的发展趋势和企业应如何针对性应用,为现场三十余位企业高管们展开了一场精彩的讲座。

企业如何驾驭人工智能

人工智能诞生至今已走过60年光阴,真正再次点燃人类的热情应该是一年前的此时AlphaGo在所谓无法穷尽枚举的围棋上完胜人类专业棋手,有人说它标志着人类迈入了超级智能的“后图灵时代”。

Nick先生对企业面对这一新形式提出了,企业应尤其重视机器学习和自然语言理解方向的应用,在策略上要

- 以始为终,从业务需求找出需要AI解决的问题;

- 小心尝试,着手数据的获取、预处理和建模;

- 螺旋前进,用迭代的理念步步趋近;

其后,来自医药、地产、零售、汽车、金融和科技企业的高管们针对AI在企业中应扮演的角色、如何将企业创新与科技创新相结合的商业模式、如何定义可信的AI平台等展开了深入的讨论。

人工智能驱逐人类

最近刷爆了朋友圈的一篇文章认为,还有23年,超级智能将超越人类,人类只能去火星避难。文中提到特斯拉的霸道总裁Elon Musk正为此忧心忡忡而开发了SpaceX准备将来拯救人类于火星。这一逻辑十(nao)分(dong)正(da)确(kai),去了火星就能逃避一切,占尽先机的人工智能凭什么不去多抢块资源呢?

2012 年的 Google Brain 实验中,使用的神经网络的参数高达 10 亿个,而人类大脑皮层有接近 150 万亿个神经元突触,看起来差距巨大。但要考虑到摩尔定律计算能力以 10 年千倍的速度在提升,达到 150 万亿这个量级,只需要 20 年左右。估计原文作者以此为依据,判定了我们人类终将被AI驱逐的悲惨结局。

人工智能的研究路径

人工智能粗略地分为“强人工智能”和“弱人工智能”。前者就是模拟完整的一个人,不仅能完成各种专项任务,还有思想,有灵魂。后者就是类似Alpha狗这样,是围棋超级高手,却并没有独立意识,Alpha狗其实并不知道什么是围棋。要把人类赶到火星以远,那要强人工智能发展到一定阶段,并且有了赶走人类、统治地球的思想。且不谈人类会有意选择智能发展方向,就技术本身的发展而言,未来23年不太可能,未来2、300年估计也不那么容易。我们下面就从AI研究的两条研究路径谈谈这个问题的难度。

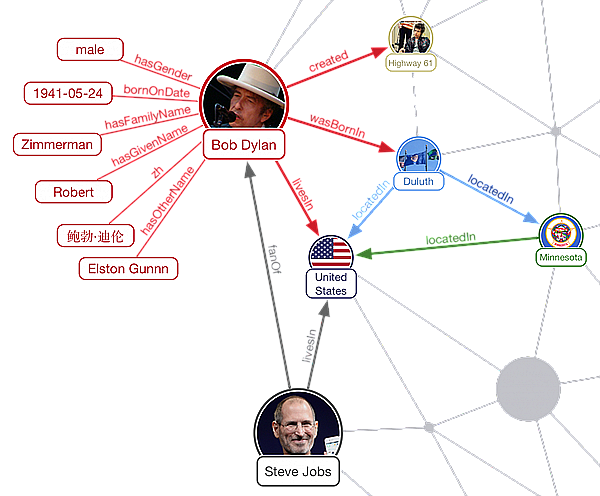

人工智能是对人类智能的一种模仿。大体上分自上而下和自下而上的两种方法论。前者称为知识导引(学术上叫符号主义),代表是专家系统和知识工程,大体上是把知识用规则的方式总结出来,整理后存进“专家知识库”,以使得这个系统能根据这些知识对各个具体问题提出解决方案。基本上是基于数理逻辑的推理以及状态空间搜索。这种系统的成败的确主要取决于专家知识是否能被知识工程师们有效地表达成计算机所能利用的形式。

在二十年前的计算机科学研究中,“语义网”(semantic web)、“本体论”(ontology)、“知识图谱”(knowledge graph),隐形概念网络HNC等等。尽管细节和重点不同,但这些工作都致力于把人类知识表示成计算机程序能直接使用的形式,其中的“知识”包括常识,也包括专业性知识。

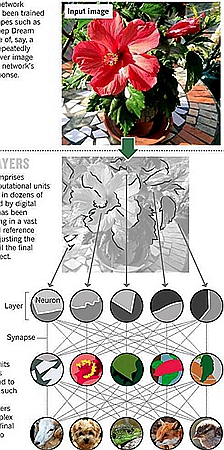

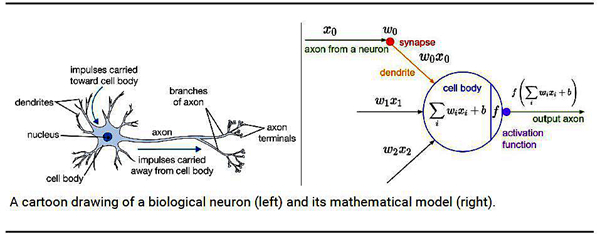

另外一种自下而上的思路是基于对大数据的机器学习(学术上叫连接主义):人工神经网络(Artificial Neural Network)是机器学习的一种,也是今天方兴未艾的浪潮。神经网络本身也是对人脑神经元的一种比较粗糙的模拟。从这个角度看,非常符合人们对创造智能的直觉。

如火如荼的机器学习的逆袭

一个n-1维超平面把n维空间一分为二,两边分属不同的两类,这种分类器就叫做神经元。神经元只能切一刀。解决办法是多层神经网络,底层神经元的输出是高层神经元的输入。我们可以在中间横着砍一刀,竖着砍一刀,然后把左上和右下的部分合在一起,与右上的左下部分分开。只要你能砍足够多刀,把结果拼在一起,什么奇怪形状的边界神经网络都能够表示,所以说神经网络在理论上可以表示很复杂的函数/空间分布。

神经网络的概念早在 1943 年就被提出了,但神经网络要求的庞大计算量在那个年代几乎不可能实现。一直到William 99年读博士期间,神经网络在学术界已经不仅仅是被忽视,而是被鄙视的了。一篇带有神经网络字样的论文送到相关的学术期刊,多半很快会被直接拒绝掉。多少计算机专业博士因此整日以泪洗面、延期毕业啊:-P

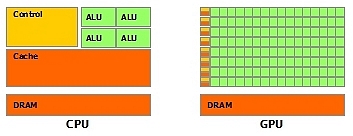

神经网络的突围是颇具戏剧性的。1999 年,显卡厂商Nvidia提出并在随后成功普及了 GPU 的概念。GPU 的核心目的是处理电脑游戏中同时出现的大量像素点。换言之,GPU 适用于大规模的并行计算。神经网络的计算主要是有许多大量的矩阵运算组成,正是 GPU 所擅长的同类问题并行计算问题。2007年 Nvidia 推出 GPU 软件接口 CUDA ,开启了 GPU 在 AI 领域的广泛应用。现在高大上的人工智能–神经网络竟然是被游戏厂商拯救的,这你敢信吗?

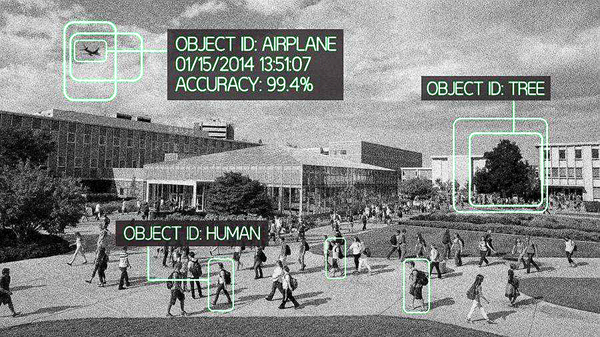

前不久离开的百度首席科学家吴恩达(Andrew Ng)2009 年指出,使用 GPU 的运算速度是传统双核 CPU 的 70 倍。2012 年吴恩达与学生联合发表的实验。他们用 1000 万个 YouTube 视频训练了一个 9 层的深度神经网络,这个网络的参数(weights)数量达到了 10 亿。这个神经网络后来在没有人工干预的情况下自发识别出了大量物体,其中最多的是猫。后来许多人把这个试验戏称为“Cat Experiment”,不得不对吴教授再次敬仰下,IEEE帮助公布婚讯也是没谁了,希望你和夫人伉俪携行、幸福美满。

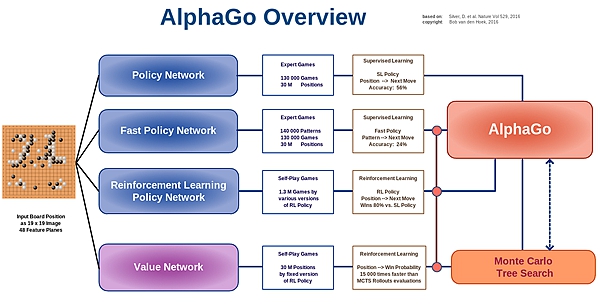

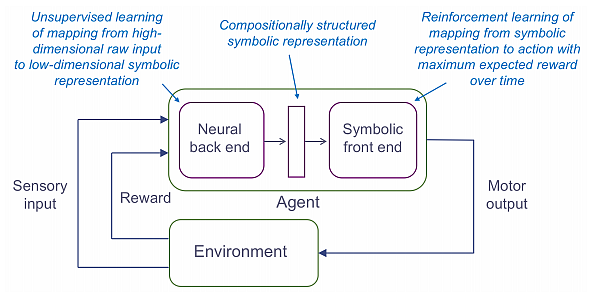

之后就是AlphaGo 战胜李世石的事情了。AlphaGo 所做的就是把不同的工具和算法组合起来,结合了深度学习网络,增强学习(Reinforcement Learning)和蒙特卡洛树搜索(Monte Carlo Tree Search),起到了非常好的效果。

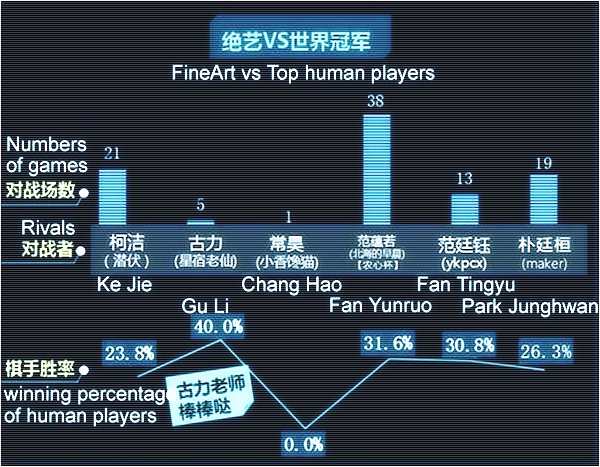

其实今年腾讯的产品FineArt(绝艺)也击败了人类围棋选手,伟大的天朝在科技上的追击能力也是让人叹为观止的。

上下贯通何其难

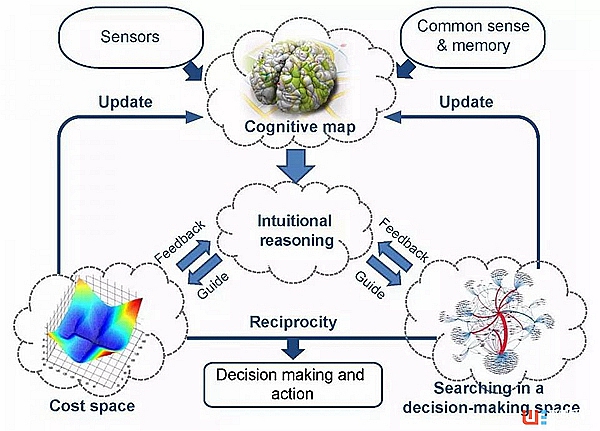

要从一个弱的智能到通用智能,必须要克服学习到认知的困难。目前来讲两个大体的路径。

其一是知识驱动和数据驱动相结合。知识驱动跟语义挂钩,是理解;数据驱动是黑箱的方法,不理解,但可以保持从数据中提取模型。那么,前面那个必须有人工做模型,知识驱动方法是用离散的符号表示,深度学习是用高维空间里的向量,这两个东西我们如果能把它 “沟通” 起来,就会把人工智能推动非常大地一步。

另外一个办法,就是回到神经网络的本源。它是根据神经网络和深度学习借助于人脑神经的工作机制来形成的,我们一般把计算方法、深度学习沟通起来。深度学习能让计算机获得常识似乎是其已有成果的自然拓展。深度学习在自然语言理解上的办法和它处理图片和语音的办法相似,即通过反复训练把输入材料压缩编码为网络参数,也就是所谓“词语向量”(word vectors)和“思想向量”(thought vectors)。说这些向量表征了常识,是指它们可被用来完成某些查询或推理任务,比如判断两段词语的语义相似程度。

尤瓦尔•赫拉利在《未来简史》中提到,我们是创造下一代的上帝,也是毁掉我们自己的魔鬼。AI真的能替代人类吗?AI 的终极形式是什么?有些问题无法回答,但也有能确定的。人工智能系统从自己经验中总结出来的知识和人类常识不会完全一样,AI看起来不应该是人类的模样。

终极的终极、未知的未来

也许有一天AI终于和人类一样完成了自身的进化,我们无法想象那是否是人类进化一样的一个艰苦的历程,更何况人类一定会从自身存亡的角度对智能研究本身进行一定的取舍。

我们相信,AI会愈来愈强大,但回归到创造知识体系和认知体系本身,诚如拒领诺贝尔文学奖的Bob Dylan的歌词唱的那样~~

How many roads must a man walk down

Before you call him a man

How many seas must a white dove fly

Before she sleeps in the sand

And how many times must a cannon ball fly

Before they're forever banned

The answer my friend is blowing in the wind

The answer is blowing in the wind

......

AI will transform many industries. But it’s not magic.

—吴恩达, 2016.11.9, HBR

强人工智能尚需时日,至少23年内我们应该生存无虞。